Всеки ден се появяват безброй заглавия от безброй източници по целия свят, предупреждаващи за тежки последици и обещаващи утопични бъдещи - всичко това благодарение на изкуствения интелект. AI „преобразува работното място“, пише Wall Street Journal, докато списание Fortune ни казва, че сме изправени пред „AI революция“, която ще „промени живота ни.“ Но всъщност не разбираме как ще взаимодейства с AI - или какъв трябва да бъде.

Оказва се обаче, че вече имаме концепция, която можем да използваме, когато мислим за AI: Това е как мислим за животните. Като бивш треньор на животни (макар и накратко), който сега изучава как хората използват ИИ, знам, че обучението на животни и животни може да ни научи много на това как трябва да мислим, да подходим и да взаимодействаме с изкуствения интелект, както сега, така и в бъдеще.

Използването на аналогии с животни може да помогне на обикновените хора да разберат много от сложните аспекти на изкуствения интелект. Това може също да ни помогне да мислим как най-добре да научим тези системи на нови умения и, може би най-важното, как можем правилно да представим техните ограничения, дори когато празнуваме новите възможности на AI.

Гледайки ограничения

Както обяснява експертът по ИИ Маги Боден, "Изкуственият интелект се стреми да накара компютрите да правят такива неща, които умовете могат да правят." Изследователите на ИИ работят върху обучението на компютри да разсъждават, възприемат, планират, движат и създават асоциации. AI може да вижда модели в големи набори от данни, да прогнозира вероятността да се случи събитие, да планира маршрут, да управлява графика за среща на човек и дори да играе сценарии за военни игри.

Много от тези възможности сами по себе си не са изненадващи: Разбира се, робот може да се търкаля в дадено пространство и да не се сблъсква с нищо. Но някак AI изглежда по-вълшебно, когато компютърът започне да сглобява тези умения, за да изпълнява задачи.

Вземете например автономни автомобили. Произходът на автомобила без шофьори е в проекта на Агенцията за напреднали научноизследователски проекти от 1980 г., наречен Autonomous Land Vehicle. Целите на проекта бяха да насърчи изследванията на компютърното зрение, възприятието, планирането и роботизирания контрол. През 2004 г. усилията на ALV станаха първото Grand Challenge за самостоятелно шофиране на автомобили. Сега, повече от 30 години от началото на усилията, ние сме на пропастта на автономните или самостоятелно управлявани автомобили на цивилния пазар. В първите години малко хора смятат, че подобен подвиг е невъзможен: Компютрите не могат да карат!

И все пак, както видяхме, те могат. Възможностите на автономните автомобили са сравнително лесни за разбиране. Но ние се борим да проумеем техните ограничения. След фаталната катастрофа на Tesla през 2015 г., при която функцията на автопилот на колата не успя да усети преминаване на трактор-ремарке в лентата му, все още малцина все още разбират тежестта на това колко ограничен е наистина автопилотът на Tesla. Въпреки че компанията и нейният софтуер бяха освободени от небрежност от Националната администрация за безопасност на движението по магистралите, остава неясно дали клиентите наистина разбират какво може и какво не може да направи колата.

Ами ако на собствениците на Tesla не им бъде казано, че карат „бета“ версия на автопилот, а по-скоро полуавтономна кола с умствената еквивалентност на червей? Така наречената „интелигентност“, която осигурява „пълна способност за самостоятелно шофиране“, наистина е гигантски компютър, който е доста добър да усеща обектите и да ги избягва, разпознавайки елементи в изображения и ограничено планиране. Това може да промени вижданията на собствениците за това колко наистина може да направи колата без човешки принос или надзор.

Какво е?

Технолозите често се опитват да обяснят AI от гледна точка на това как е изградена. Вземете например напредък, постигнат в задълбоченото обучение. Това е техника, която използва многопластови мрежи, за да се научи как да изпълнява задача. Мрежите трябва да обработват огромно количество информация. Но поради обема на необходимите им данни, сложността на асоциациите и алгоритмите в мрежите, на хората често не е ясно как те научават какво правят. Тези системи може да станат много добри при една конкретна задача, но всъщност не ги разбираме.

Вместо да мислим за AI като за нещо свръхчовешко или чуждо, е по-лесно да ги анализираме с животни, интелигентни нечовеци, които имаме опит за обучение.

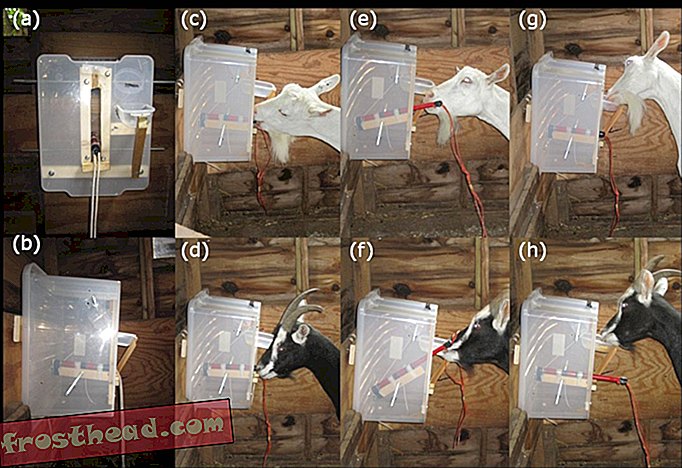

Например, ако използвах обучение за подсилване, за да обуча куче да седи, бих похвалил кучето и ще му дам лакомства, когато той седи на команда. С времето той ще се научи да свързва командата с поведението с лакомството.

Обучението на AI система може да бъде почти същото. В процеса на задълбочено обучение човешките дизайнери създават система, предвиждат това, което искат да научи, дават информация, наблюдават нейните действия и ѝ дават обратна връзка (като похвала), когато видят какво искат. По същество ние можем да третираме AI системата, както ние се отнасяме към животни, които тренираме.

Аналогията работи и на по-дълбоко ниво. Не очаквам седящото куче да разбере сложни понятия като "любов" или "добро". Очаквам той да се научи на поведение. Точно както можем да накараме кучетата да седят, да стоят и да се преобръщат, така можем да накараме AI системи да движат автомобили около обществени пътища. Но е твърде много да се очаква колата да "реши" етичните проблеми, които могат да възникнат при спешни случаи.

Помага на изследователите също

Мисленето на AI като тренируемо животно не е полезно само за обяснението му пред широката публика. Също така е полезно за изследователите и инженерите, изграждащи технологията. Ако изследовател на AI се опитва да научи системата на ново умение, мисленето на процеса от гледна точка на треньор на животни може да помогне да се идентифицират потенциални проблеми или усложнения.

Например, ако се опитам да обуча кучето си да седи и всеки път, когато кажа „седнете“, зумерът до фурната изгасне, тогава моето куче ще започне да свързва седенето не само с моята команда, но и със звука на бръмча на фурната. По същество зумерът се превръща в друг сигнал, който казва на кучето да седи, което се нарича „случайно усилване“. Ако потърсим случайни подсилвания или сигнали в AI системи, които не работят правилно, тогава ще знаем по-добре не само какво става погрешно, но също така и каква конкретна преквалификация ще бъде най-ефективна.

Това изисква да разберем какви съобщения даваме по време на обучение за ИИ, както и какво може да наблюдава AI в заобикалящата ни среда. Звукът на фурната е прост пример; в реалния свят ще бъде много по-сложно.

Преди да приветстваме AI своите господари и да предадем живота и работата си на роботи, трябва да направим пауза и да помислим за вида интелект, който създаваме. Те ще бъдат много добри в извършването на конкретни действия или задачи, но не могат да разберат понятия и не знаят нищо. Така че, когато мислите да обстрелвате хиляди за нов автомобил Tesla, не забравяйте, че функцията му за автопилот наистина е просто много бърз и секси червей. Наистина ли искате да дадете контрол върху живота и близките си на червей? Вероятно не, така че дръжте ръцете си върху колелото и не заспивайте.

Тази статия първоначално е публикувана в The Conversation.

Хедър Роф, старши научен сътрудник, катедра „Политика и международни отношения“, Оксфордския университет; Научен сътрудник, Инициатива за глобална сигурност, Аризонски държавен университет